Перейти к:

Нейросетевая система видеонаблюдения

https://doi.org/10.35266/1999-7604-2024-4-3

Аннотация

Целью представленной работы является разработка и внедрение эффективной и доступной по цене автоматической системы видеонаблюдения, способной работать в режиме реального времени и интегрироваться с существующими системами видеонаблюдения. Представленный метод включает в себя анализ существующих на рынке решений, выбор и обучение модели глубокого обучения для обнаружения предметов, разработку пользовательских интерфейсов, контейнеризацию приложения и тестирование системы в реальных условиях. Результатом работы стала система, способная обнаруживать интересующие объекты в режиме реального времени с помощью нейронных сетей и уведомлять пользователя об обнаружении. Система предназначена для использования в общественных местах, таких как аэропорты, вокзалы, школы и другие учреждения, требующие повышенной безопасности.

Для цитирования:

Василенко Н.Е., Медведева Н.А. Нейросетевая система видеонаблюдения. Вестник кибернетики. 2024;23(4):25-33. https://doi.org/10.35266/1999-7604-2024-4-3

For citation:

Vasilenko N.E., Medvedeva N.A. Neural network surveillance system. Proceedings in Cybernetics. 2024;23(4):25-33. (In Russ.) https://doi.org/10.35266/1999-7604-2024-4-3

ВВЕДЕНИЕ

В настоящее время разработка видеосистем автоматического обнаружения предметов, входящих в область интересов, имеет критическое значение в контексте обеспечения общественной безопасности [1, 2]. Такие системы обещают значительно улучшить реакцию на потенциальные угрозы и инциденты, предотвращая их возникновение или минимизируя их последствия. Однако существует ряд проблем, связанных с трудностями внедрения, установки, конфигурации и обслуживания подобных систем.

При разработке системы использовались современные методы машинного обучения и искусственного интеллекта, подходы к созданию веб- и десктоп-приложений, а также данные о существующих решениях на рынке. Были проанализированы различные подходы к видеоаналитике и детектированию объектов, такие как алгоритм YOLO и методы сверточных нейронных сетей.

Актуальность работы обусловлена ростом глобальных угроз, таких как преступность и несанкционированные действия, а также возрастающими требованиями к общественной и частной безопасности. Интеграция современных алгоритмов глубокого обучения в систему, способную работать в реальном времени и предоставлять высокую точность обнаружения обещает дать толчок в развитии, как таких систем, так и всей сферы безопасности в целом.

Существуют решения, разработанные такими компаниями, как Videonet, ZeroEyes, Athena Security, Actuate и NtechLab, которые также направлены на улучшение безопасности с использованием видеоаналитики и искусственного интеллекта.

После анализа этих решений можно выделить ряд их недостатков:

- Закрытость кода: все продукты компаний, кроме NtechLab, которые показали достоинства их алгоритма, не предоставляют доступ к исходному коду, ограничивая возможности развития, кастомизации и интеграции под специфические потребности.

- Высокая стоимость лицензирования, поддержки и обновлений делают такие системы недоступными для многих организаций, не говоря о персональном использовании.

- Сложность интеграции с существующими системами безопасности из-за возможной несовместимости или отсутствия необходимых интерфейсов.

МАТЕРИАЛЫ И МЕТОДЫ

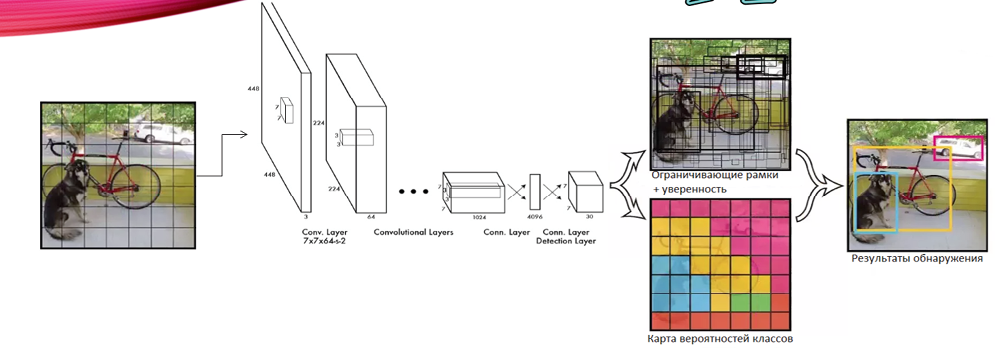

При проектировании системы была выбрана модель YOLO («You Only Look Once») [3–6] для задачи обнаружения предметов в реальном времени, что обусловлено рядом причин (рис. 1).

Прежде всего, эта модель представляет собой эффективную архитектуру нейронной сети, в которой входное изображение разбивается на сетку, и каждая ячейка сетки отвечает за обнаружение объектов в своей области.

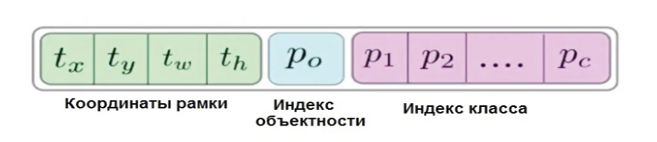

Параметры этих ячеек (рис. 2) в виде векторов [7] являются выходным результатом работы модели, в основе которой лежит принцип сверточной нейронной сети.

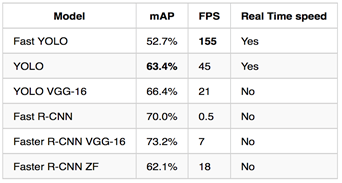

Для получения предсказаний модели, изображению требуется пройти через нее всего один раз. Это отличает алгоритм YOLO от других алгоритмов обнаружения объектов и позволяет выполнять инференс с высокой скоростью (рис. 3), что очень важно для системы, работающей в режиме реального времени.

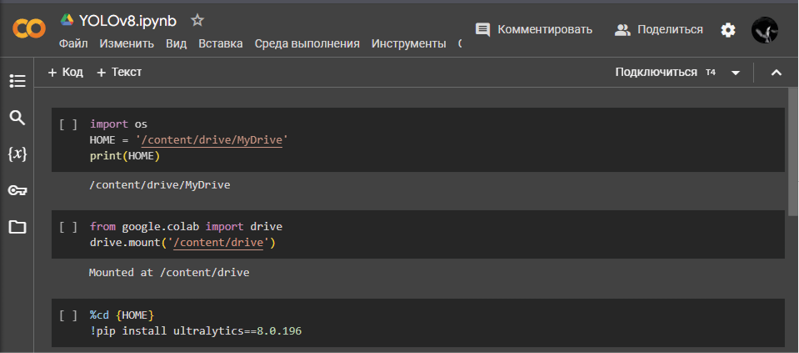

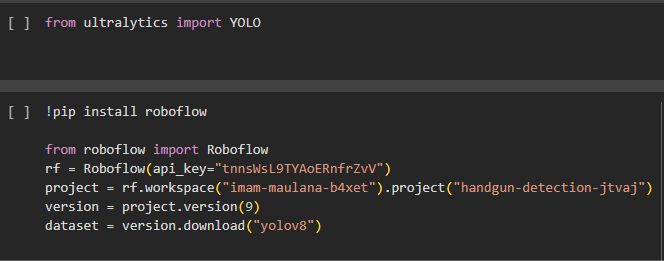

Установка необходимых библиотек, импортирование модели, установка датасета, обучение модели и экспорт файла весов производились в среде Google Colab с подключенным Google хранилищем для сохранения файловой структуры проекта (рис. 4–5) [8].

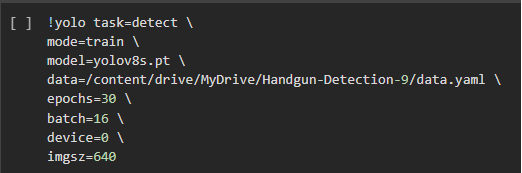

Параметры обучения (рис. 6) подбирались экспериментальным путем для выведения наилучшей точности модели. Крайний вариант модели обучался на протяжении 30-ти эпох, с количеством образцов данных, обрабатываемых нейронной сетью за одну итерацию, равную 16-ти, и с использованием более 4-х Гб видеопамяти.

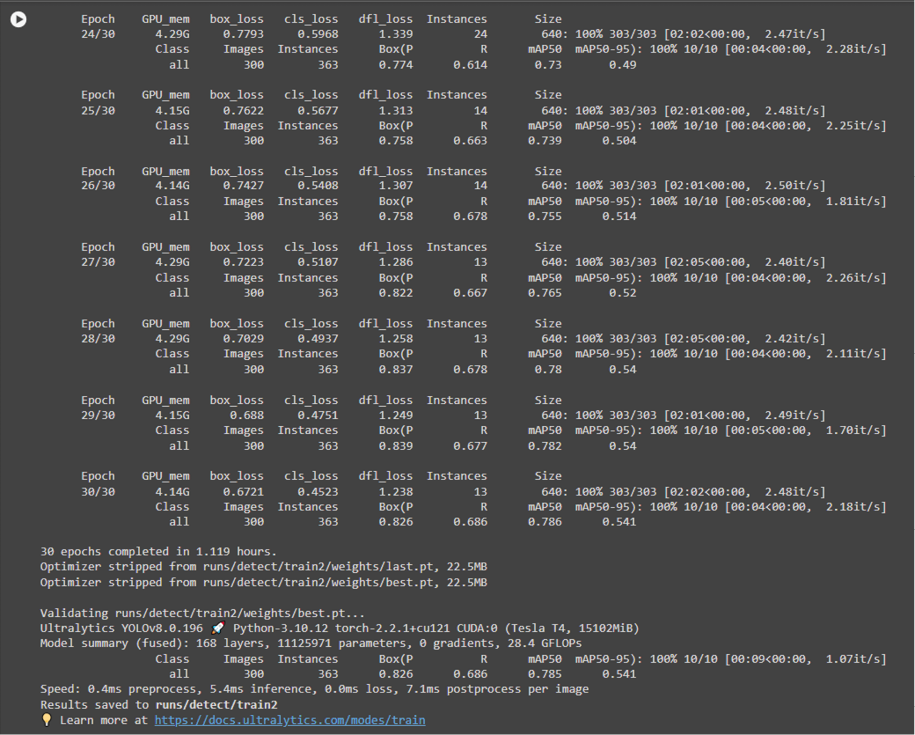

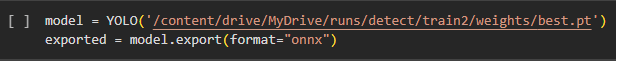

При конечном инференсе (рис. 7–9) модель показала 78,5 % средней точности, что, относительно затраченных ресурсов, является хорошим показателем.

Для создания системы автоматического оповещения пользователя об обнаружении нежелательных предметов в реальном времени использовались современные технологии для реализации серверной и клиентской части программного обеспечения:

- Qt Designer – инструмент для построения графических интерфейсов для программ, которые используют библиотеку Qt.

- Разработка веб-приложения осуществлялась с использованием фреймворка Flask. Его главным преимуществом является простая и гибкая архитектура, позволяющая создавать веб-приложения любой сложности.

- Платформа для контейнеризации Docker, с помощью которого программный код упаковывается в единый исполняемый файл вместе с библиотеками и зависимостями, чтобы обеспечить его корректный запуск.

- Библиотека PyQt5 для верстки стороны клиента и создание алгоритма обнаружения предметов для десктоп-приложения.

Рис. 1. Принцип работы алгоритма YOLO

Примечание: составлено авторами по [3].

Рис. 2. Параметры ячеек изображения

Примечание: составлено авторами по [3].

Рис. 3. Сравнение скорости и производительности моделей, обученных с наборами данных PASCAL VOC 2007 и 2012 гг.

Примечание: составлено авторами.

Рис. 4. Подключение Google хранилища и установка библиотеки для работы с моделями ИИ

Примечание: составлено авторами.

Рис. 5. Импорт модели YOLO и установка датасета с помощью библиотеки Roboflow

Примечание: составлено авторами.

Рис. 6. Метод обучения модели на установленном датасете с определенными параметрами обучения

Примечание: составлено авторами.

Рис. 7. Зафиксированные последние эпохи обучения модели с выводом результатов

Примечание: составлено авторами.

Рис. 8. Экспорт файла весов в необходимый для дальнейшей работы формат

Примечание: составлено авторами.

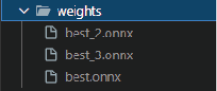

Рис. 9. Каталог с файлами весов

Примечание: составлено авторами.

РЕЗУЛЬТАТЫ И ИХ ОБСУЖДЕНИЕ

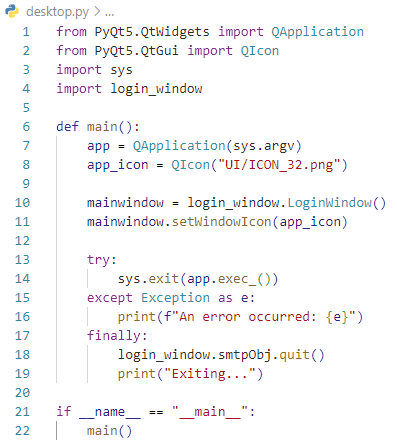

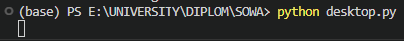

В файле «desktop.py» находится код, интерпретация которого (рис. 10) создаст объект «QApplication», представляющий собой основное окно приложения PyQt5. После чего создастся экземпляр «LoginWindow» (окно входа), установится иконка окна и оно отобразится (рис. 11).

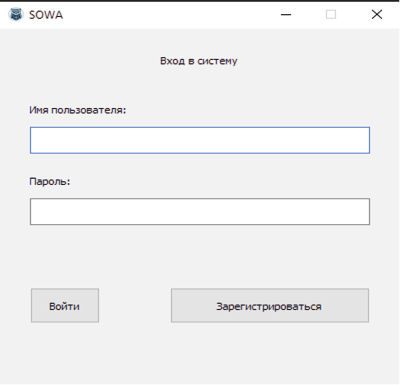

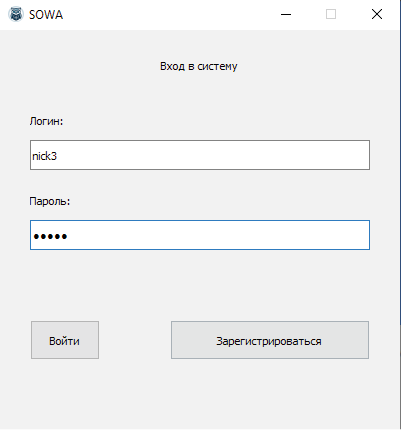

Откроется следующее окно. Если пользователь не регистрировался ранее, то он может это сделать нажатием кнопки «Зарегистрироваться» (рис. 12).

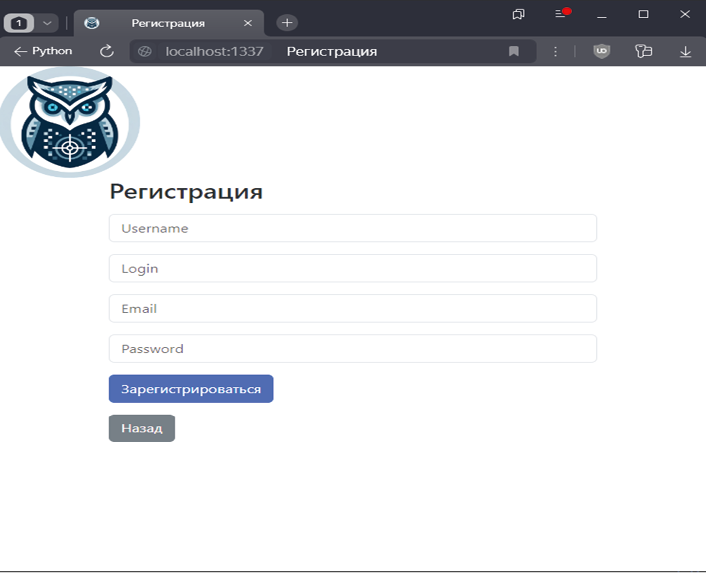

Это действие откроет веб-страницу с разделом регистрации, что позволит пользователю зарегистрироваться (рис. 13).

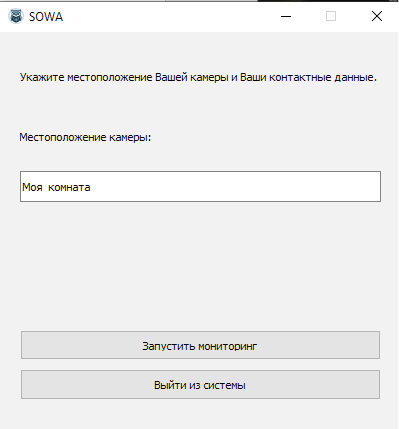

После регистрации пользователь может войти в личный кабинет. Теперь, после вноса пользователя в базу данных, можно успешно войти систему локально и указать местоположение камеры, с помощью которой планируется проводить мониторинг (рис. 14–15).

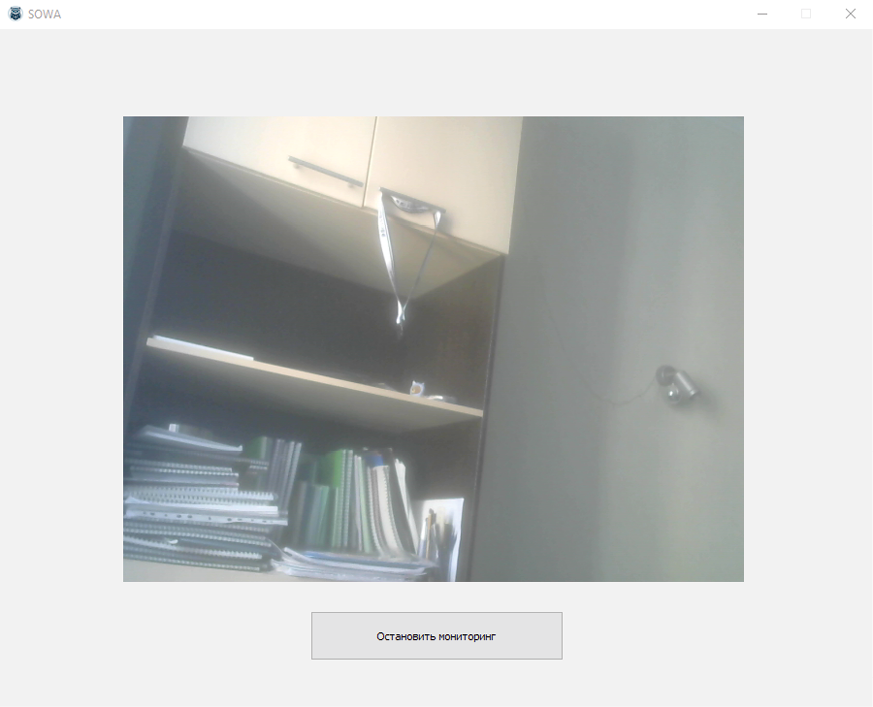

Запустив мониторинг, перед пользователем появится окно мониторинга, где изображение будет передаваться в реальном времени с указанной камеры (рис. 16).

Рис. 10. Содержимое файла desktop.py

Примечание: составлено авторами.

Рис. 11. Команда запуска приложения пользователя

Примечание: составлено авторами.

Рис. 12. Окно входа

Примечание: составлено авторами.

Рис. 13. Страница регистрации

Примечание: составлено авторами.

Рис. 14. Вход в систему

Примечание: составлено авторами.

Рис. 15. Заполнение полей окна настройки

Примечание: составлено авторами.

Рис. 16. Процесс мониторинга

Примечание: составлено авторами.

ЗАКЛЮЧЕНИЕ

В рамках научно-исследовательской работы была разработана и реализована интегрированная система, которая включает в себя следующие основные компоненты:

- Обнаружение предметов в реальном времени. Для этого были использованы технологии компьютерного зрения и глубокого обучения. Эти технологии позволяют системе анализировать видеопоток с камер наблюдения и автоматически определять наличие предметов на изображениях.

- Автоматическое оповещение. Когда система обнаруживает предметы в поле зрения камеры, она автоматически отправляет оповещение пользователю, а в личном кабинете он сможет посмотреть подробную информацию об обнаружении. Такая система позволяет оперативно реагировать на экстренные ситуации и ее применение способствует дальнейшему развитию систем безопасности с использованием современных технологий.

- Доступность и масштабируемость. Для обеспечения доступности и масштабируемости при реализации системы была использована контейнеризация. Этот подход позволил создать изолированную среду выполнения, которая легко переносится и запускается на различных платформах, включая локальные компьютеры. Благодаря этому, система становится доступной для обычных пользователей и способна к масштабированию, позволяя повысить производительность при увеличении вычислительных ресурсов.

Видеосистема автоматического оповещения пользователя об обнаружении предметов повышенного риска в реальном времени является важной частью обеспечения как общественной, так и персональной безопасности.

Список литературы

1. Ларина Ю. Событийный видеоконтроль // Безопасность. Достоверность. Информация. 2009. № 83. С. 28–40.

2. VideoNet PSIM – интеллектуальная система безопасности. URL: https://www.videonet.ru/ (дата обращения: 05.05.2024).

3. Распознавание образов с помощью искусственного интеллекта. URL: https://habr.com/ru/articles/709432/ (дата обращения: 05.05.2024).

4. YOLO: You Only Look Once – Real Time Object Detection – GeeksforGeeks. URL: https://www.geeks-forgeeks.org/yolo-you-only-look-once-real-time-object-detection/ (дата обращения: 05.05.2024).

5. Real-Time Object Identification Through Convolution Neural Network Based on YOLO Algorithm. URL: https://www.sciencepg.com/article/10.11648/j.mcs.20230805.11 (дата обращения: 05.05.2024).

6. YOLO with adaptive frame control for real-time object detection applications. URL: https://link.springer.com/article/10.1007/s11042-021-11480-0 (дата обращения: 05.05.2024).

7. D_0.06 YOLO – Head. URL: https://junha1125.github.io/blog/artificial-intelligence/2020-08-18-YOLO/ (дата обращения: 05.05.2024).

8. How to Train YOLOv8 Object Detection on a Custom Data- set. URL: https://blog.robofl ow.com/how-to-train-yolov8-on-a-custom-dataset/ (дата обращения: 05.05.2024).

Об авторах

Н. Е. ВасиленкоРоссия

магистрант

Н. А. Медведева

Россия

старший преподаватель

Рецензия

Для цитирования:

Василенко Н.Е., Медведева Н.А. Нейросетевая система видеонаблюдения. Вестник кибернетики. 2024;23(4):25-33. https://doi.org/10.35266/1999-7604-2024-4-3

For citation:

Vasilenko N.E., Medvedeva N.A. Neural network surveillance system. Proceedings in Cybernetics. 2024;23(4):25-33. (In Russ.) https://doi.org/10.35266/1999-7604-2024-4-3